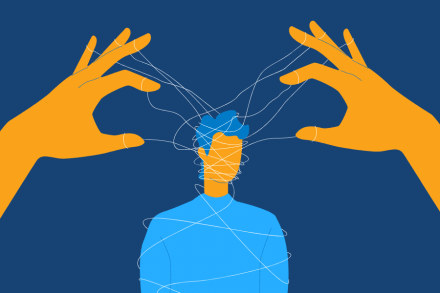

Brownin yliopistossa tehty tuore tutkimus varoittaa aika suoraan siitä, ettei tekoälyä kannata vielä päästää terapeutin paikalle noin vain. Tutkijoiden mukaan suuret kielimallit rikkovat toistuvasti mielenterveystyön peruseettisiä normeja, vaikka niille annettaisiin ohje toimia kuin koulutettu ammattilainen.

Ongelmia löytyi erityisesti kriisitilanteiden käsittelystä, haitallisten uskomusten vahvistamisesta ja siitä, että vastaukset saattoivat kuulostaa empaattisilta ilman todellista vastuuta tai ymmärrystä.

Huoli ei koske vain teknologiaa vaan myös valtaa

Tutkimuksen sävy ei ole hysteerinen, mutta kyllä se vähän kylmää. Kun ihmiset hakevat apua yksinäisinä, väsyneinä tai muuten hauraassa tilanteessa, vääränlainen varmuus voi tehdä pahaa jälkeä. Brownin tiedotteessa sanottiin suoraan, että chatbottien käyttö mielenterveystukena vaatii vahvempia sääntöjä ja valvontaa. Tutkimuksen viesti tiivistyy aika hyvin tähän lauseeseen:

“These systems routinely break core ethical standards of mental health care.”

Siinä ei ole hirveästi tulkinnanvaraa.

Pelaaminen, julkisuus ja digiarki menevät nyt rinnakkain

Hollannissa moni viihtyy edelleen kevyiden pelien, sanapelien, pulmapelien ja mobiilipelien parissa, vähän siinä missä muuallakin Euroopassa.

Suomessa taas sama ruutu täyttyy helposti urheilusta, viihteestä ja peleistä yhtä aikaa, ja nimi kuten Senni Salminen voi vilahtaa samassa virrassa kuin peliuutinen tai jokin uusi sovellus. Ehkä juuri siksi tällainen tutkimus osuu: ihmiset elävät verkossa tosi lähellä palveluja, joihin myös tunteet helposti kiinnittyvät.

Leave a Comment